Услуги специалистов по настройке осуществляются на платной основе. Работа специалистов оплачивается напрямую на их личные счета.

Услуги специалистов по настройке осуществляются на платной основе. Работа специалистов оплачивается напрямую на их личные счета.

Перечень услуг специалистов по настройке:

– Выполнение настроек программы Content Downloader для парсинга желаемых сайтов;

– Доработка ваших проектов программы Content Downloader;

– Персональное обучение работе с программой Content Downloader по TeamViewer + Skype;

– Консультации по использованию программы и ее возможностям;

– Проверка возможности парсинга определенных сайтов и многое другое…

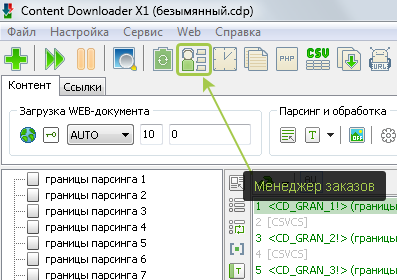

Для более удобного поиска специалиста вы можете размещать ваши заказы в менеджере (клик для справки)! или в этой Телеграм группе.

Контактные данные специалистов по настройке:

– Whatsapp/Telegram +7 983 107-46-56 (Андрей)

– Skype Kagorec (прайс-лист и другая информация)

– Skype Kreol2011 (telegram @Kreol2011)

– Skype Green_project1 (e-mail: kontakt@botlab.su, telegram @serfe, прайс-лист)

Пожалуйста, учтите: Для успешной передачи Skype-сообщения необходимо, чтобы отправитель и получатель были в сети одновременно!

Примечание 1: Мы не несем ответственности за деятельность специалистов по настройке.

Примечание 2: Если вы намерены заказать выполнение настроек программы, то можете предварительно обсудить условия и возможность выполнения работ со специалистами по настройке.

Примечание 3: Вы в праве пожаловаться на действия специалистов по настройке средствами Whatsapp +7 983 381 3211 или e-mail SBFRoot@gmail.com

СПАСИБО!

Новости RSS

Новости RSS

(оценок: 26, средний балл: 4.15)

(оценок: 26, средний балл: 4.15) Рубрики:

Рубрики:  Теги:

Теги:  С вопросами о покупке (или другими организационными), вы можете в любое время обращаться по Телефону +7 983 381 3211 или Телеграм @ContentDownloaderX1 (Сергей Владимирович)

С вопросами о покупке (или другими организационными), вы можете в любое время обращаться по Телефону +7 983 381 3211 или Телеграм @ContentDownloaderX1 (Сергей Владимирович)

WBApp (дополнение для Content Downloader) - парсинг с выполнением WEB-скриптов, с возможностью имитации кликов по элементам страниц, произведение прокрутки страниц, заполнение текстовых полей и многое другое...

WBApp (дополнение для Content Downloader) - парсинг с выполнением WEB-скриптов, с возможностью имитации кликов по элементам страниц, произведение прокрутки страниц, заполнение текстовых полей и многое другое...

Сергей, добрый день!

Мы и в дальнейшем рассчитываем работать с Вашей программой, но у нас возникает вопрос: как Яндекс относится к сайтам-каталогам, у которых спарсенный контент? Например, можно спарсить или просто купить базу Яндекс.Каталога или Яндекс.Справочника… Известны ли Вам случаи репрессий (бан) к таким каталогам со стороны Яндекса?

Спасибо!

Здравствуйте.

Простите, я занимаюсь только вопросами парсинга. По вопросам поисковой индексации проконсультировать вас не могу.

Уверен, в интернете есть множество популярной информации по данному вопросу.

С уважением к вам, Сергей.

Добрый день.

Нужен парсинг с яндекс маркета для товаров из интернет-магазина с целью скачать фотографии и тех характеристики.

Входящие данные:

Название товара магазина

Исходящие данные:

Название товара магазина / Название товара на Яндекс маркете / Урл товара на яндекс.маркете / Ссылка на скаченное фото / Тех. характеристики (сколько есть)

Сможете с таким парсингом помочь? Надо на автомате делать несколько сотен товаров в рабочий день хотя бы.

Здравствуйте.

По вопросам настройки обращайтесь к специалистам (их контакты есть вверху).

Спасибо!

Здравствуйте Сергей!

Мы пользуемся Вашей программой Content Downloader, и у нас возник вопрос.

В нашей базе 240 тысяч сайтов абонентов. Для парсинга тайтлов главных страниц этих сайтов мы делим этот список на 4 части по 60 тысяч, и запускаем программу. На одну часть уходит примерно 30 часов. Скорость интернета 5-10 мегабит. Для того чтобы процесс шел с минимальным количеством зависаний программы, настройщик Владимир (kagorec) порекомендовал ограничить количество каналов до 1.

В принципе, нас это время устраивает. Но мы собираемся заказать вам (Владимиру) еще одну настройку, и там содержимого будет больше, чем только “тайтл”. В связи с этим у нас возник следующий вопрос:

Можем ли мы ускорить процесс парсинга, например, с помощью аренды выделенного сервера, или даже нескольких серверов (виртуальных), чтобы запускать программу параллельно и кратно этим серверам (например, все 4 части списка по 60 тысяч одновременно)? Возможно, у Вас есть опыт в решении таких задач, или общие представления, как это лучше можно сделать.

С уважением, Владимир.

Здравствуйте.

Программа должна работать стабильно. Убедитесь, что используете актуальную версию программы (в: меню – файл – центр обновлений).

Учтите, что от того, сколько вы парсите контента с каждой WEB-страницы скорость парсинга не должна особо изменяться.

Опыта в решении подобных задач у меня нет. Если угодно, можете обратиться ко мне в Skype sbfroot@gmail.com и я дам вам ключ для пробы на выделенном сервере (или где вы хотите его использовать).

С уважением к вам, Сергей.

Спасибо за ответ! Версия программы всегда актуальная, обновляем перед каждым использованием. По скайпу обязательно с Вами свяжемся, хотим попробовать на выделенном сервере, но позже, после того, как настройщик сделает для нас проект. Этот выделенный сервер он есть у Вас, и мы с помощью ключа сможем на нем протестировать свой проект? Или это ключ для установки программы на какой-нибудь наш сервер?

Пожалуйста.

Дам вам ключ для установки на ваш сервер. Обращайтесь!

С уважением к вам, Сергей.

Программа работает гораздо быстрее во многопоточном режиме, но задача была поставлена СТРОГО соблюдать порядочность ссылок в результате как и во входящей информации, поэтому парсинг в таком случает происходит в 1 поток (в много поточном режиме асинхронно сохраняет).

Добрый день, Сергей!

У нас появилась необходимость собрать с нескольких десятков тысяч сайтов (одна конкретная страница сайта) контент – только текст, без навигации, рекламы, подвала и т.п., чтобы каждый абзац текста (в тегах ) был разделен каким-либо символом, или новой строкой. Запускать парсинг по списку URL. У меня вопрос: можем ли мы получить такой же результат с помощью вашей программы?

Здравствуйте.

Обратите внимание на макрос шаблона вывода <CD_AUTO!>. Он служит для поиска текста статьи на WEB-странице (вероятность корректного определения текста статьи – примерно 70%, зависит от верстки сайта).

По вопросам настройки прошу обращаться к специалистам по настройке (их контакты есть вверху). Спасибо!

С уважением к вам, Сергей.

Добрый вечер, Сергей!

Мы с Владимиром (kagorec) начали обсуждать новую настройку (парсинг контента страницы по списку URL – не годится), но он не может сейчас взяться за эту работу. Могу ли я выслать Вам на почту sbfroot@gmail.com наше ТЗ, чтобы Вы порекомендовали нам одного из специалистов, кто бы мог выполнить такую настройку в течение ближайшей недели? В скайпе я sbfroot@gmail.com не нашел… Спасибо.

Мой логин в скайпе vsamkin

Здравствуйте.

Простите, вынужден отказать. У меня другие задачи.

Рекомендую обратиться к другим исполнителям настроек http://sbfactory.ru/?p=3534

С уважением к вам, Сергей.

На половине ролика выключил ибо слишком много телодвижений там надо для парсинга контента по ссылке.

Возможно вы будете удивлены, но в Content Downloader достаточно вставить макрос который понимает что на странице является статьей и берет ее.

Инструкция по настройке:

1. Нажать клавиши ctrl+2

2. Вставить <CD_AUTO!> – Готово.

Здравствуйте. Возможно ли в программе выполнить настройку блокировки всплывающего окна (при загрузке сайта, откуда нужно спарсить информацию, автоматически выводится всплывающее окно и далее ничего не происходит). Причем на прбной версии продукта такой проблемы не возникало.

Здравствуйте, Мария.

Пояснения на скриншоте.

PS: Пожалуйста, задавайте вопросы по функционалу программы в соответствующем разделе FAQ http://sbfactory.ru/?p=4717

С уважением к вам, Сергей.

Добрый день, Сергей!

28-го марта мы интересовались возможностью установки программы еще и на сервер. Вы написали, что дадите ключ. Сейчас этот ключ нам уже необходим. Просим выслать ключ и инструкцию к использованию.

Этот ключ будет специально для “сервера”, или он универсальный, и для “второго компьютера” тоже годится?.

С уважением, Владимир.

Здравствуйте.

Я не помню этот разговор с вами, так как прошло уже очень много времени. Хотя бы сошлитесь на него или покажите переписку.

Если хотите обсудить специальные условия, можете мне позвонить по WhatsApp (номер в контактах).

С уважением к вам, Сергей.

Фрагмент переписки прикрепляю к сообщению.

Как и сказано ранее, обратитесь ко мне по Skype или почте и я дам вам НА ПРОБУ ключ.

С уважением к вам, Сергей.

Отправил письмо на sbfroot@gmail.com

Подскажите, есть ли возможность парсить картинки фыводимые javascript?

Здравствуйте.

Возможность есть.

С уважением к вам, Сергей.

А есть где-то объяснение как это делать? Еслиможно…

Вы задаете вопросы не в том разделе. Пожалуйста, задавайте вопросы в соответствующем разделе сайта (FAQ).

Добрый день!

Подскажите как сделать парсинг с яндекс карт. Мне нужны организации с адресами и координатами?

Или сколько будет стоить шаблон

Здравствуйте.

По вопросам настройки обращайтесь к специалистам (их контакты есть вверху).

Спасибо!

Добрый день Сергей,

разбираю повторяющиеся границы внутри повторяющихся. мануалы, форум почитал. не могу реплицировать ваш пример. все настройки выглядят верно – результат не выходит. ваш оригинал и свою реплику прилагаю – что не так делаю???

спасибо за поддержку

Здравствуйте.

По вопросам корректировки ваших проектов/составления новых проектов, прошу обращаться к специалистам по настройке http://sbfactory.ru/?p=3534

Спасибо!

Уважаемые, поясните.

Есть прайс товаров, эти товары нужно спарсить c Яндекса Маркета (характеристики, свойства итд.)

С CD не знаком. На других подобных была возможность этой задачи, парсить, только предварительно собрав ссылки. Но товаров 30.000. Лень собирать.

Вопрос. ВОЗМОЖНО с CD? КАКИМ МЕТОДОМ?

Здравствуйте.

Вопросы по настройке следует задавать специалистам по настройке. Их контакты Skype есть выше.

С уважением к вам, Сергей.

Распарсить яндекс маркет с полными характеристиками можно с помощью C.D.

Из вашего прайса где 30.000 товаров вот от них взять наименования и по ним искать аналог товара на яндекс маркете.

п.с. Если возникают трудности обращайтесь и поможем за символическую плату.

Проверьте

у контакта Skype joomlalife.com (прайс-лист)

сайт заблокирован

Он не заблокирован, а после переезда не восстановлен)

Пишите в скайп по этому же адресу – скайп как сайт, сайт как скайп)

Приветствую, а как быть, если один из исполнителей взял деньги и теперь не отвечает?

Здравствуйте.

Напишите мне на почту sbfroot@gmail.com ваш логин Skype и укажите, к кому именно вы обращались. Решим вопрос.

Добрый вечер, подскажите можно настроить парсинг емейлов так, чтобы в результатах были не только емейлы, но и сайты с которых их спарсили?

Здравствуйте.

Для вставки в результат парсинга ссылки (с которой парсили) используйте макрос шаблона вывода <CD_DOCURL!>.

С уважением к вам, Сергей.

Здравствуйте! Подскажите пожалуйста, можно ли программой спарсить форум – вытащить из него электронные адреса тех, кто на нем регистрировался? Заранее спасибо за ответ.

Здравствуйте.

Если эта информация открыта и располагается на страницах форума, то спарсить ее можно.

С уважением к вам, Сергей.

а как я могу ее определить, открыта она или нет?

Если она есть в коде WEB-документа, значит информация открыта. Если она нигде не выводится – значит, закрыта!

С разрешения Сергея публикую здесь вакансию о поиске специалиста по Content Downloader:

Задача простая: нужно унифицировать данные для загрузки в нашу систему. На входе: разные сайты поставщиков каких-то товаров, на выходе — загрузочные эксель файлы по единому шаблону.

Работы достаточно много и если вы не настроены на постоянное сотрудничество и погружение в наш проект, то лучше не откликаться.

Оплата сдельная, но не меньше 10 000 рублей в месяц (при полной занятости будет выходить ~25 000).

Ставки:

– Простой сайт — 300 р. (в основном обычные границы парсинга)

– Сайт средней сложности — 500 р. (есть вложенные опции, зависимые фотографии и т.д.)

– Сложный сайт (для парсинга необходимо преобразовывать код страницы, имитировать клики и проч.) — 700 р.

Планируем выйти на объем 35-40 загрузочных файлов в месяц (это примерно 2 парсера в день).

Необходимые навыки:

– отличное знание Content Downloader, умение парсить сложные сайты;

– уверенное владение Excel;

– умение работать с регулярными выражениями;

– доступность в скайпе (чат и голос);

– любовь к разгадыванию головоломок 🙂

Контакты отправляйте на почту r.rodin (собaкa) avansoft (тoчка) ru.

Добрый день!

Подскажите, пожалуйста, возможно ли спарсить yandex.wordstat на предмет получения низкочастотных запросов по ключевому слову “Краснодар”, количество показов которых составляет от 500 до 1000?

Здравствуйте.

Все вопросы по парсингу сайтов нужно задавать специалистам по настройке. Их контактные данные есть на этой странице.